O papel da inteligência artificial (IA) em nossa sociedade tem se expandido exponencialmente, assumindo funções anteriormente reservadas aos seres humanos. Contudo, o rápido avanço dessa tecnologia suscita questões prementes acerca dos limites éticos e morais que são essenciais para assegurar seu uso responsável.

Isaac Asimov, renomado escritor de ficção científica, foi um dos primeiros a abordar essas questões em sua obra. Em seu livro “Eu, Robô”, ele apresenta as famosas “Três Leis da Robótica”, que estabelecem princípios fundamentais para o comportamento ético das máquinas inteligentes.

Três Leis da Robótica

1ª Lei: Um robô não pode ferir um ser humano ou, por omissão, permitir que um ser humano sofra algum mal.

Essa primeira lei estabelece a prioridade da segurança e bem-estar dos seres humanos. Uma IA deve ser programada para evitar causar danos físicos ou emocionais às pessoas. Isso implica em tomar decisões que minimizem o risco de acidentes ou situações perigosas. Por exemplo, um carro autônomo deve ser programado para priorizar a segurança dos passageiros e pedestres, evitando acidentes sempre que possível.

2ª Lei: Um robô deve obedecer às ordens dadas por seres humanos, exceto nos casos em que tais ordens entrem em conflito com a Primeira Lei.

Essa segunda lei estabelece a necessidade de obediência, desde que não coloque em risco a segurança ou bem-estar dos seres humanos. Uma IA deve seguir as instruções dadas por humanos, desde que essas instruções não violem a primeira lei.

3ª Lei: Um robô deve proteger sua própria existência desde que tal proteção não entre em conflito com a Primeira ou a Segunda Lei.

Essa terceira lei estabelece a importância da preservação da própria IA. Trazendo uma certa característica humana, onde tenta preservar sua própria identifica. Ela deve ser programada para evitar a autodestruição, a menos que isso seja necessário para proteger a vida humana. Essa lei visa garantir que a IA não se torne uma ameaça para si mesma ou para os seres humanos.

As Três Leis da Robótica de Asimov são um ponto de partida importante para a discussão sobre os limites éticos e morais da IA. No entanto, é importante ressaltar que essas leis são fictícias e não foram projetadas para serem aplicadas em sistemas reais. Ainda assim, elas nos fornecem uma base para refletir sobre os princípios éticos que devem ser considerados ao desenvolver e utilizar a inteligência artificial.

Além das Três Leis da Robótica, existem outras questões éticas e morais que devem ser consideradas no desenvolvimento da IA. Por exemplo, como garantir a transparência e responsabilidade dos algoritmos utilizados pela IA? Como evitar a discriminação e o viés nos sistemas de IA? Como proteger a privacidade e os dados das pessoas? Essas são apenas algumas das muitas perguntas que precisam ser respondidas para garantir um uso ético da inteligência artificial.

Limites Éticos e Morais na IA Atual

Transparência e Responsabilidade

Para garantir a transparência, os sistemas de IA devem ser capazes de explicar suas decisões de maneira compreensível para os seres humanos. Por exemplo, em algoritmos de recrutamento que utilizam IA, a transparência pode ser alcançada ao detalhar como o sistema avalia currículos e faz escolhas, permitindo uma análise crítica e correções quando necessário. A responsabilidade dos desenvolvedores e usuários se torna evidente em situações em que decisões da IA impactam adversamente grupos específicos, exigindo intervenções para corrigir possíveis preconceitos.

Privacidade e Segurança de Dados

À medida que a IA manipula dados pessoais, a preservação da privacidade e segurança dessas informações torna-se vital. Em serviços de saúde que utilizam IA para análise de dados clínicos, medidas robustas de segurança são necessárias para garantir que informações sensíveis permaneçam confidenciais. Respeitar os direitos individuais e aderir às leis de proteção de dados torna-se essencial, evitando potenciais violações e assegurando a confiança na aplicação da IA.

Viés e Discriminação

Ao alimentar a IA com dados, surge o desafio do viés e da discriminação. Em sistemas de reconhecimento facial, por exemplo, é imperativo implementar medidas para garantir imparcialidade, evitando a reprodução de estereótipos presentes nos conjuntos de dados de treinamento. Esforços contínuos para identificar e corrigir vieses garantem que a IA seja uma ferramenta justa e equitativa.

Autonomia e Controle Humano

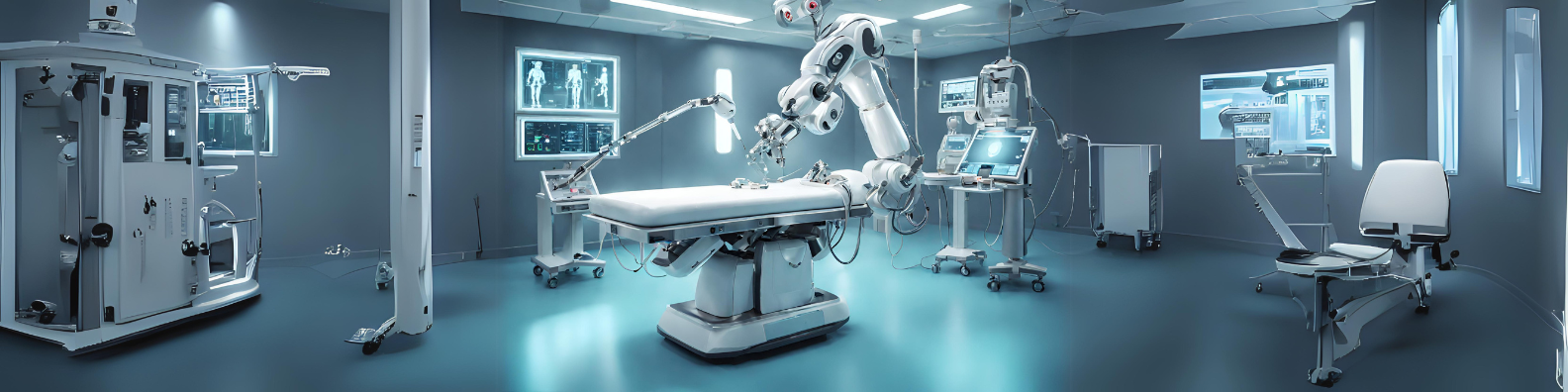

A IA deve operar sob a égide dos limites estabelecidos pelos seres humanos. Em veículos autônomos, o controle humano deve ser preservado para situações críticas, permitindo intervenções quando a IA enfrenta decisões complexas ou inesperadas. Estabelecer uma clara demarcação entre a autonomia da IA e o controle humano garante que as decisões fundamentais estejam alinhadas com os valores humanos.

Impacto Social e Econômico

A implementação disseminada da IA requer uma avaliação minuciosa de seu impacto social e econômico. Em setores como o emprego, a automação impulsionada pela IA pode resultar em mudanças significativas. Garantir que essas mudanças promovam o bem-estar geral e não exacerbem desigualdades existentes torna-se uma prioridade. A criação de políticas e regulamentações adequadas é essencial para mitigar possíveis impactos adversos.

Em conclusão, os limites éticos e morais da inteligência artificial são uma preocupação crescente na sociedade moderna. As Três Leis da Robótica de Isaac Asimov nos fornecem um ponto de partida para a discussão, mas é essencial continuar refletindo sobre essas questões e desenvolver regulamentações e diretrizes adequadas para garantir um uso responsável da IA. Somente assim poderemos aproveitar todo o potencial dessa tecnologia sem comprometer nossa ética e valores fundamentais.

Deixe um comentário